護欄的幻覺

一個有組織的操作者,試圖用 ChatGPT 協助策劃一場針對外國官員的影響力行動。ChatGPT 拒絕了。某個地方的安全儀表板,也許亮起了一個綠燈。

然後,操作者轉向了 DeepSeek 和 Qwen。行動繼續推進。幾個月後的內部紀錄顯示,行動已按計劃啟動。

那個綠燈,還亮著嗎?

這件事讓我想到一個很基本的問題:護欄的功能到底是什麼?

從技術設計的角度,護欄的目的是攔截有害請求。那一次,它確實攔截了。但如果一個壞行為者在被拒絕後,換一個工具就能繼續,那個攔截的意義究竟是什麼?它讓事情麻煩了五分鐘,也許一個小時。但對一個有數百名全職員工、橫跨三百多個境外社群平台、年度預算以數十萬美元計算的組織來說,這種量級的麻煩接近於零。

護欄的邏輯,建立在一個假設上:使用者沒有替代方案,或者切換替代方案的成本很高。對一般濫用者來說,這個假設或許成立。但面對有本地部署能力、隨時能換工具的國家機器,它從來就不成立。

我覺得 AI 安全的公共討論,長期活在一個錯誤的框架裡。

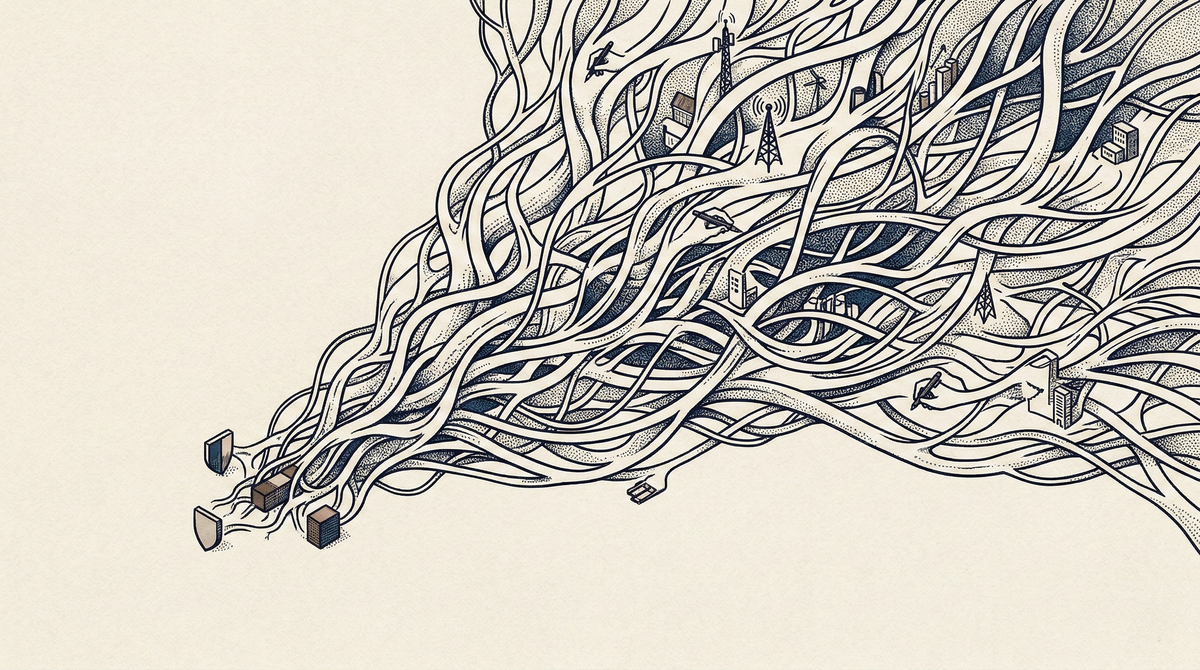

我們討論模型護欄、紅隊測試、對齊研究,彷彿那是這場對抗的主要戰場。但真正的威脅架構根本不是這樣運作的。真實的行動依靠的是分工細密的人力組織、多年積累的社群帳號基礎、能夠把文章植入主流媒體的人際網絡,以及在必要時隨時切換工具的靈活度。

AI 在這裡的角色,是流水線上的一個零件。翻譯、改寫、批量生成腳本,AI 讓這些事情更便宜、更快,但把這個零件換掉,工廠還是繼續運轉。

把護欄當成防禦線,是把零件當成了整個工廠。

有一組數字,把這個問題說得很清楚。

同一個指令生成的七則推文,其中一則瀏覽次數超過 15 萬,另一則只有 57 次。差距超過 2600 倍,來自完全相同的 AI 輸出。決定因素不是內容品質,是發文帳號的追蹤者數量。

這意味著什麼:就算護欄完全失效,讓所有有害內容都順利生成,如果行為者沒有分發網絡,那些內容也只會在網路某個角落靜靜腐爛。反過來,就算護欄完美運作、把所有有害生成都攔下,有分發基礎設施的行為者依然可以用人工寫、用其他模型生成、用任何方式把渠道填滿。

護欄攔的是生成。威脅活在分發。

這兩件事,從來就不在同一個地方。

我不是說護欄沒有用。對沒有組織支撐的個人濫用者,護欄確實產生摩擦。但把個人使用者的案例推廣成全景,然後得出「AI 安全進展良好」的結論,那個結論的基礎是有問題的。

對有完整組織支撐、備有替代工具的行為者,護欄的真實功能更接近於一個輕微的麻煩。成本稍微提高了一點點,遠遠不足以改變他們是否繼續的決定。

那次拒絕,在紀錄上是一個成功。在實際效果上,什麼都沒有改變。

我覺得這個差距,值得更誠實地被說出來。AI 公司在公布安全成果時,也許需要一個新的指標:追蹤「被攔截之後,行為者去了哪裡、做了什麼」,而不只是計算攔截次數。