Claude.ai 完整入門:從提示技巧到模型選擇

每次打開空白頁面,面對龐大的專案卻不知從哪下手,這種感覺並不陌生。過去,你可能靠著不斷查資料、找同事討論、反覆修稿來推進工作。現在,有一個工具可以讓這個過程快很多。

Claude 是一個 AI 協作平台,它不會幫你做決策,但能幫你拆解問題、整理資訊、生成草稿、分析數據。它的強項在於你給它的背景越多,它的回應就越貼近你真正需要的東西。這篇文章會帶你從介面導覽開始,一路走到提示技巧、模型選擇,把 Claude.ai 的核心功能都摸清楚。

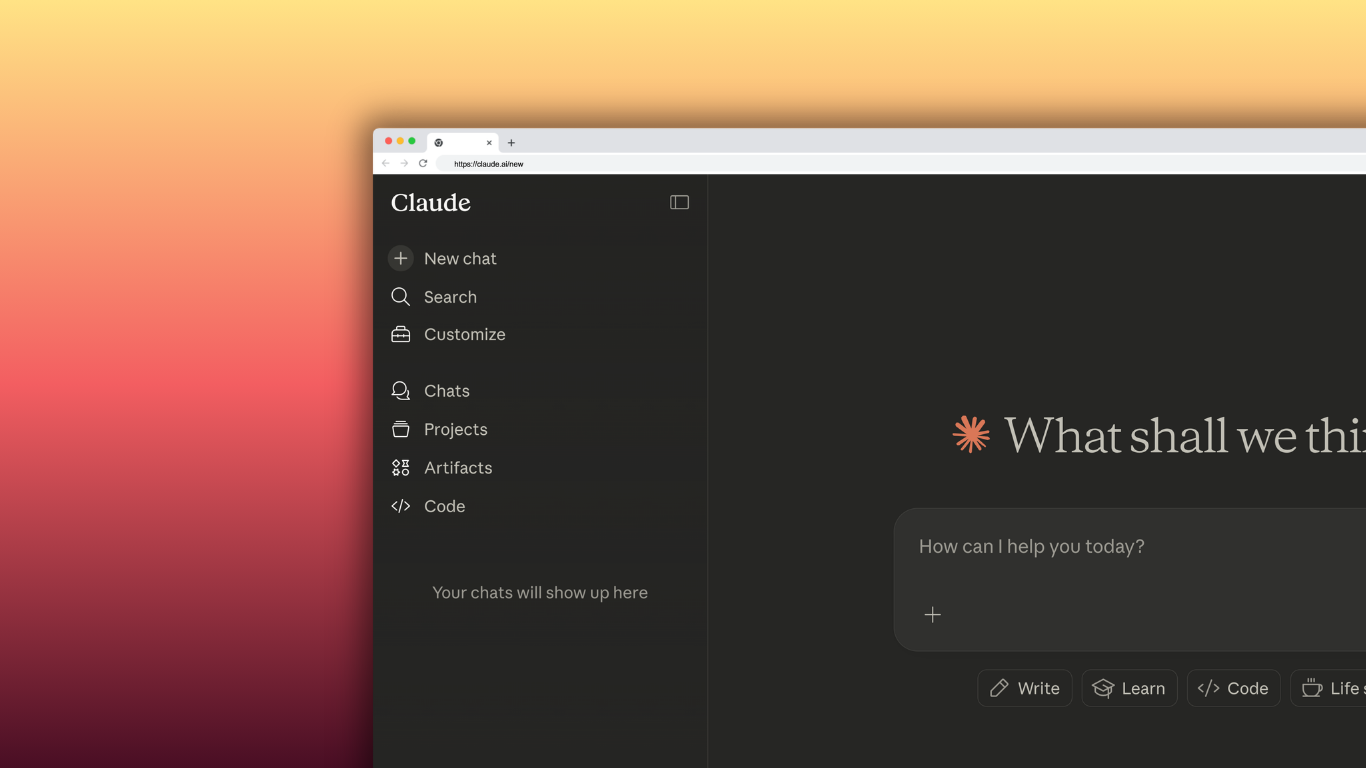

認識介面:側欄是起點

進入 Claude.ai 之後,左側的側欄是最常用到的區域,值得先花一點時間熟悉它。

側欄上方有建立新對話的按鈕,以及可以快速回到過去對話記錄的入口。往下看,你會找到「Projects」這個功能。Projects 的設計概念是把相關的對話整合在一起,加上持續性的背景說明和自訂指示,適合用在長期進行的工作項目上,比如某個產品開發週期或某個研究主題。

側欄裡還有一個「Artifacts」區塊,它讓你可以把對話中產生的內容,像是小型應用、工具介面或整理好的文件,轉成可以分享的形式。如果你在對話中產出了一個實用的東西,Artifacts 就是讓它脫離單次對話、變成可複用資產的方式。

寫出好提示的三個要素

和 Claude 溝通的品質,直接決定它的回應品質。最有效的提示方式,其實就像跟一個剛加入你團隊的同事說話:自然、簡潔、有明確目標。

一個好提示通常包含三個層次:

設定背景(Setting the Stage):告訴 Claude 這個任務的情境是什麼。你的角色是誰?這份文件是給誰看的?有沒有什麼前提條件它應該知道?比如「這是給一家新興獨立串流平台的投資人簡報」,這一句話就把受眾、目的和產業背景都交代清楚了。

定義任務(Defining the Task):你想要 Claude 做什麼?寫一份分析報告、整理一份清單、還是生成一段程式碼?動詞越具體,方向越清楚。

指定規則(Specifying Rules):你希望回應的風格或格式是什麼?需要引用來源嗎?要用專業報告的結構還是輕鬆的條列式?如果你有範例可以附上,就更好了。

把這三個層次都帶進提示裡,Claude 能做的事就不只是「猜你要什麼」,而是真正按照你的需求來回應。

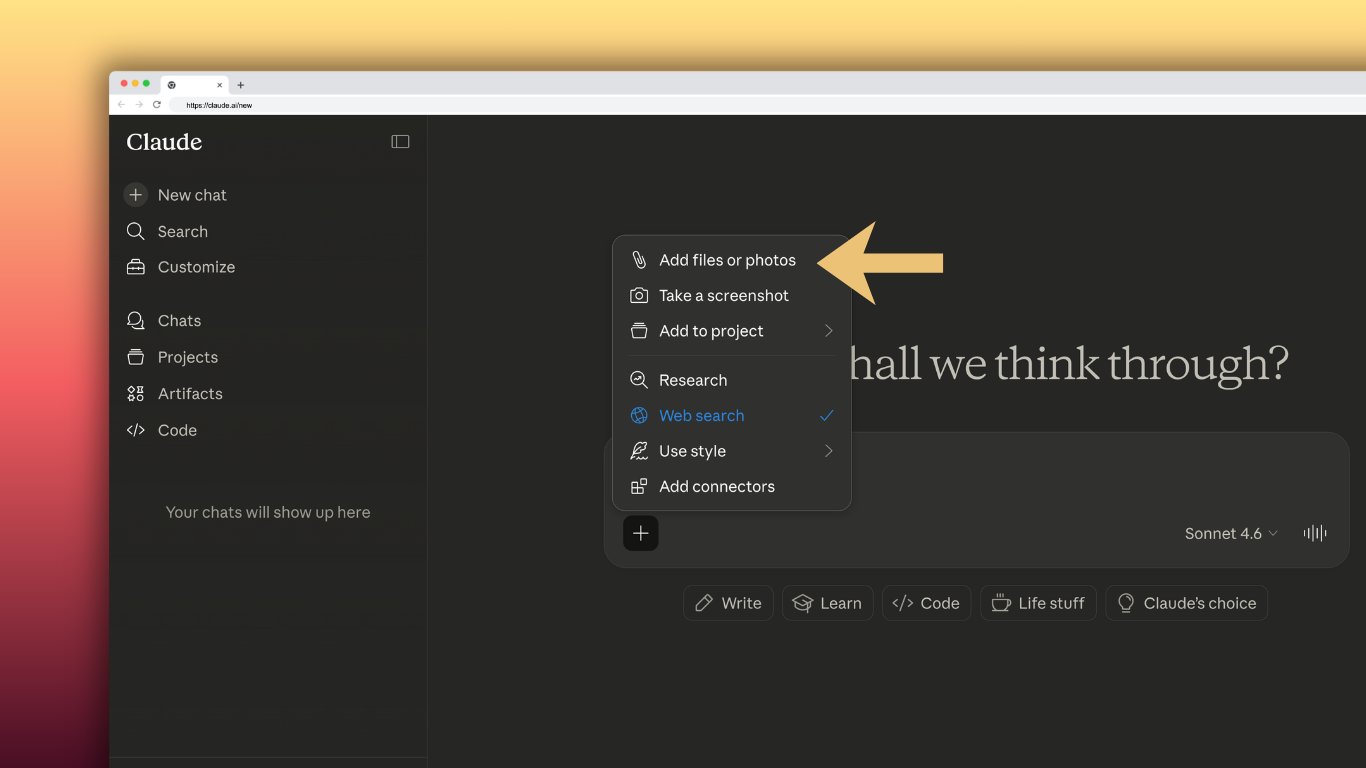

把你的背景資料帶進對話

提示寫好之後,下一步是把相關的資料帶進對話。你可以直接在聊天視窗上傳文件,Claude 會把這些文件的內容納入它的理解範圍。

這個做法特別有用的場景包括:把公司內部的規格文件上傳,讓 Claude 根據真實的產品需求回應;把過去的研究報告丟進去,讓它幫你整理出重點;或者把長篇的會議記錄貼進對話,讓它擷取出待辦清單。

支援的格式包括 PDF、CSV、Docs 以及多種常見的文件類型。把這些資料帶進對話,等於是省掉了大量的背景說明時間,Claude 能更快進入狀況。

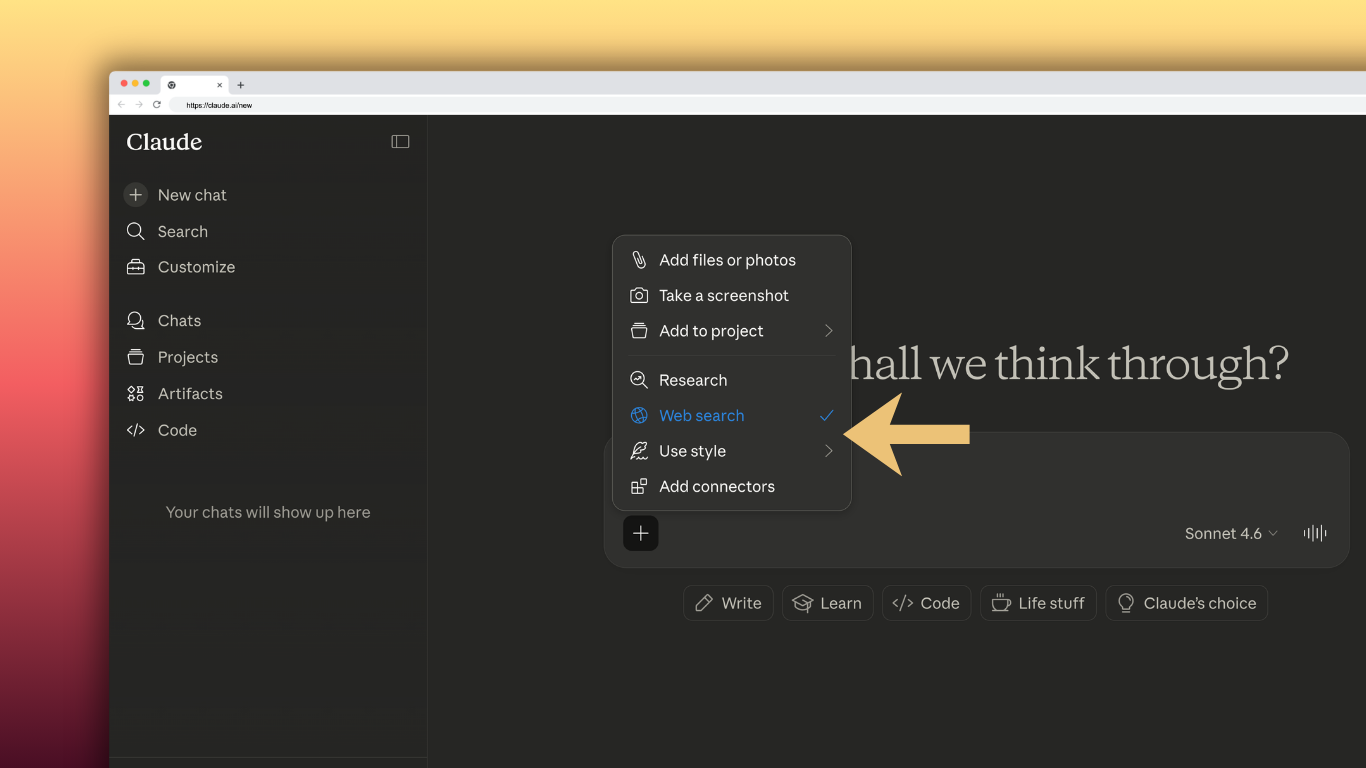

善用工具,讓 Claude 獲取即時資訊

Claude 本身的知識有訓練截止日期,所以如果你需要它接觸到現在的資訊,就要透過工具來擴充它的能力。

在對話輸入框旁邊,有一個搜尋與工具的選單。在這裡,你可以開啟幾個選項:

- 網路搜尋:讓 Claude 即時查詢當前市場數據、新聞或最新文件,不再侷限於訓練資料。

- Google Drive 連接:把你雲端硬碟裡的文件接進來,Claude 可以直接讀取,不需要你手動下載再上傳。

這些工具不是一直開著的,Claude 會根據任務判斷要不要使用,你也可以手動切換。對於需要最新資訊的任務,打開網路搜尋是個好習慣。

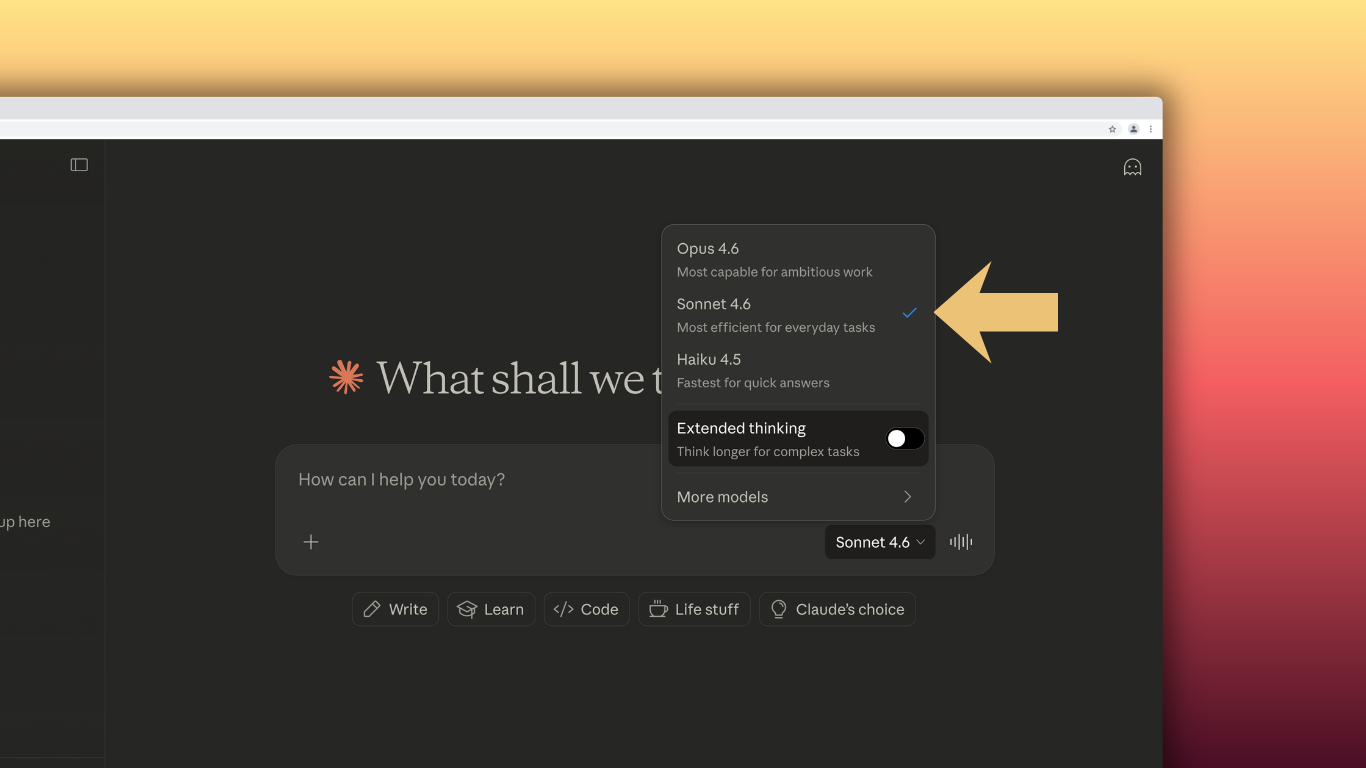

選對模型,任務更有效率

Claude.ai 提供多個模型,不同的模型在能力和速度之間有不同的取捨,選對了可以省不少時間和等待成本。

切換模型的方式很簡單:在對話輸入框下方,你會看到目前使用的模型名稱,點擊它就可以選擇其他版本。切換後會開啟新的對話。

目前主要有兩個常用選擇:

Claude Opus:規模最大的模型,具備混合推理能力,適合最複雜的任務,比如多步驟的財務分析、需要深度邏輯推演的研究,或是複雜程式碼的架構設計。速度相對慢,但在精度上有優勢。

Claude Sonnet:日常使用的首選,也是預設模型。它在能力和速度之間取得了不錯的平衡,對大多數任務來說已經足夠強大,回應速度也快得多。

簡單來說,先從 Sonnet 開始,如果發現任務需要更深的推理或分析,再換成 Opus。

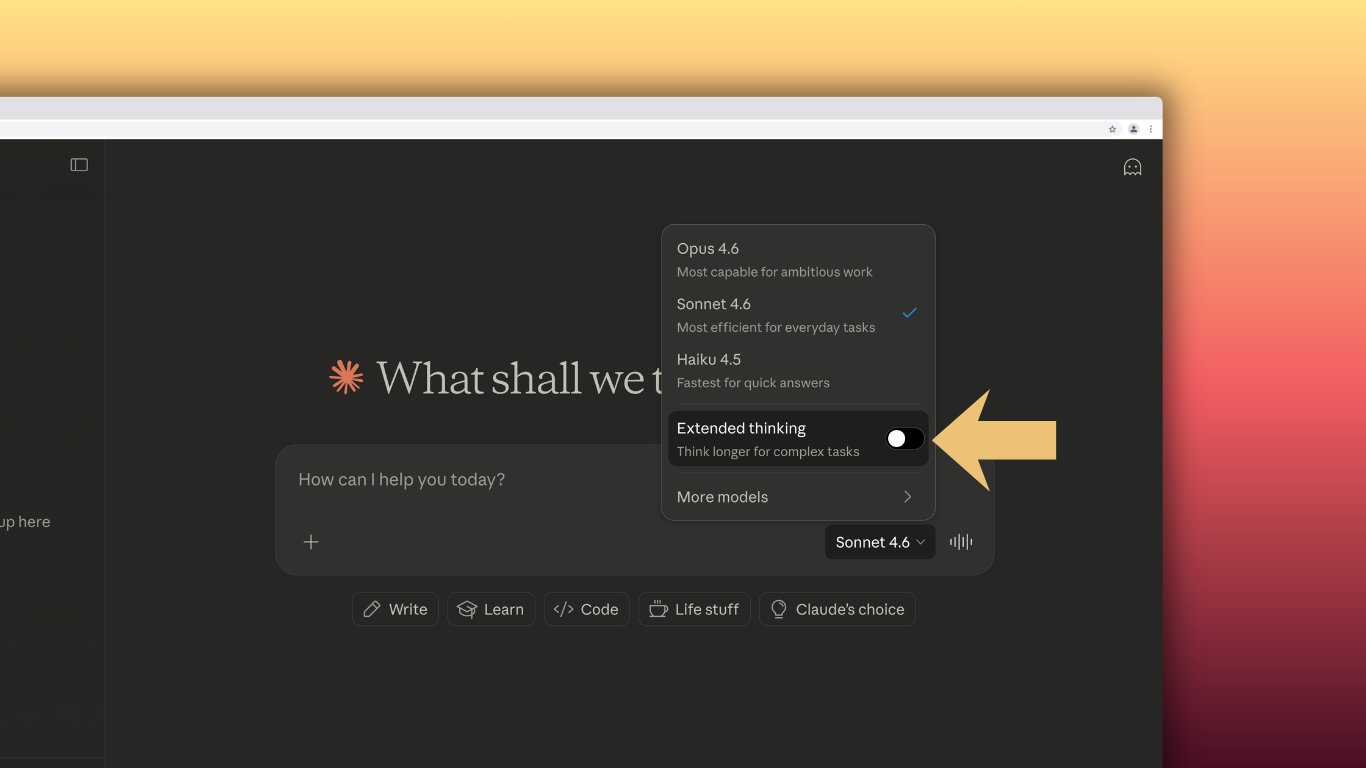

延伸思考模式與 Research 功能

延伸思考模式(Extended Thinking):開啟這個模式後,Claude 會在給出答案之前花更多時間推演,特別適合邏輯嚴密的分析或需要多步驟推理的問題。但它會增加回應時間,一般對話或簡單問題並不需要開它。

Research 功能:這是一個更自動化的深度研究工具。你提出一個複雜的問題,Claude 會自動拆解問題、搜尋數百個來源、整合成一份有引用的完整報告,整個過程大約需要 5 到 45 分鐘。適合你需要做大量資料蒐集但不想自己一個來源一個來源讀的場合。

把對話變成習慣

單次的提問能解決眼前的問題,但 Claude 真正的價值在於持續的互動。多次對話之後,它會更熟悉你的表達方式、偏好的格式和工作的背景,未來的回應也會越來越貼合你的需求。

把 Claude 當成一個需要磨合的工作夥伴,而不是一個用完即棄的搜尋引擎。每次你把更具體的背景、更清楚的需求帶進去,它就能做得更好。提示技巧、工具選擇、模型切換,這些都是你可以調整的槓桿,找到適合你工作節奏的使用方式,比一次把所有功能都弄懂更重要。